Introdução

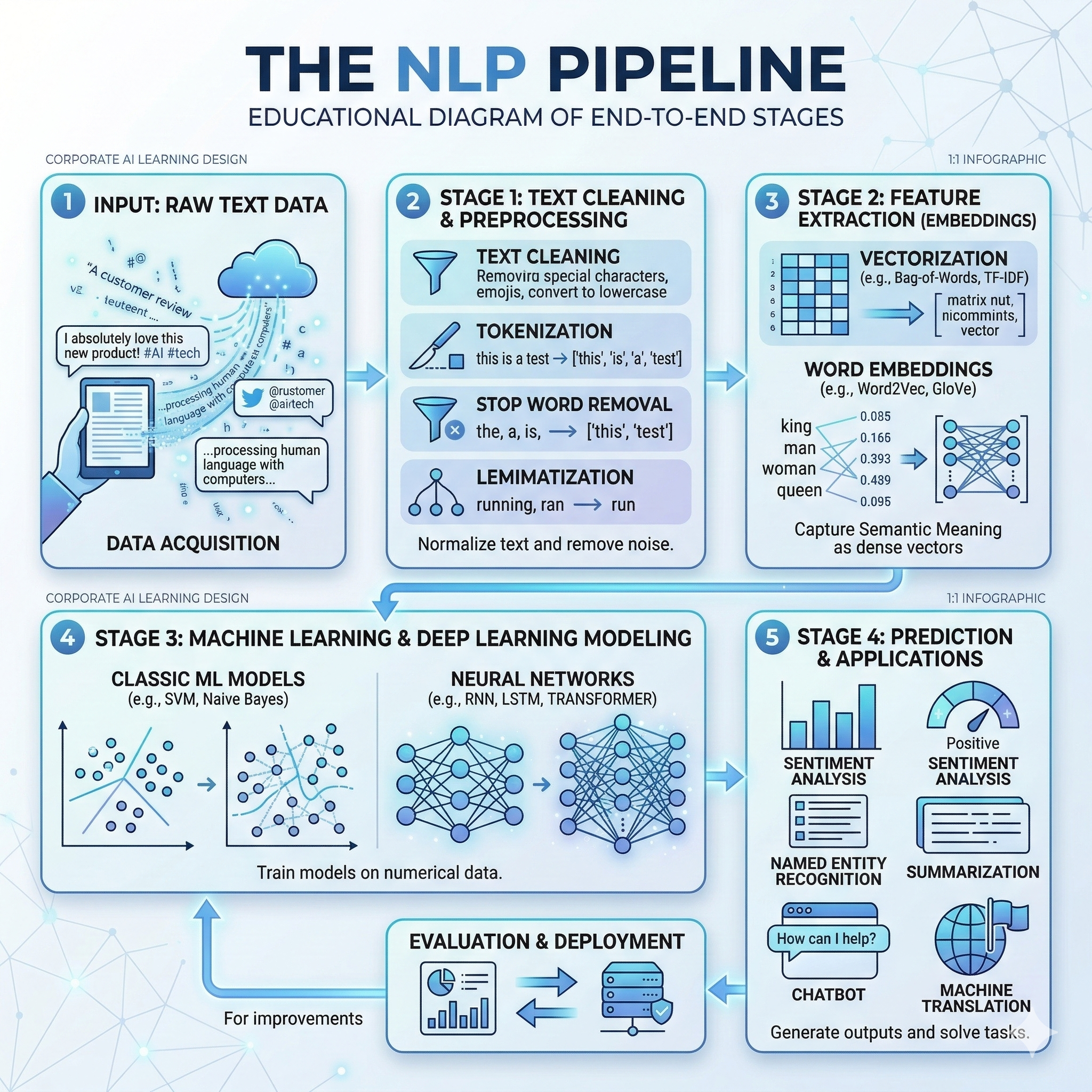

Quando vemos um modelo avançado gerando textos coerentes ou analisando sentimentos com precisão cirúrgica, é fácil focar apenas no algoritmo final. No entanto, antes de aplicar qualquer modelo de Processamento de Linguagem Natural (NLP), existe uma etapa fundamental: a preparação rigorosa dos dados textuais.

Na prática de engenharia de machine learning, sabemos que o algoritmo é tão bom quanto os dados que o alimentam. Esse processo sistemático de preparação é conhecido como pipeline de processamento de texto.

Abaixo, detalhamos as engrenagens que compõem esse motor essencial.

1. Coleta de Dadoss

O primeiro passo é obter a matéria-prima. O volume e a qualidade dessa coleta definem o potencial do projeto. Os dados textuais podem ser extraídos de uma infinidade de fontes, dependendo do objetivo:

- Redes sociais e fóruns online (para análise de tendências e sentimentos).

- Reviews de produtos em e-commerces.

- Portais de notícias e artigos científicos.

- Documentos estruturados e laudos extraídos em análises de perícia forense digital.

- Logs de digitação ou bases de conversação para treinar sistemas preditivos (como teclados virtuais para Comunicação Alternativa e Aumentativa).

2. Limpeza do Texto (Text Cleaning)

Textos do mundo real são caóticos e cheios de ruídos que não agregam valor analítico, especialmente quando lidamos com extração via web scraping ou digitalização de documentos físicos.

Nesta etapa, aplicamos filtros para padronizar a base de dados. É comum removermos:

- Caracteres especiais e pontuações excessivas.

- Tags HTML residuais.

- URLs e links quebrados.

- Emojis (dependendo do caso de uso; em análise de sentimentos, eles podem ser úteis, mas para predição de texto formal, costumam ser descartados).

- Números irrelevantes ou formatações inconsistentes.

3. Tokenização

A tokenização é a arte de quebrar o texto. Ela consiste em dividir parágrafos ou frases inteiras em unidades menores e gerenciáveis, chamadas tokens (que geralmente representam palavras ou subpalavras).

Essa é uma etapa vital antes de alimentar estruturas de dados rápidas como árvores Trie ou arquiteturas avançadas de redes neurais.

Exemplo prático:

Texto original: “Eu amo ciência de dados” Tokens resultantes:

['Eu', 'amo', 'ciência', 'de', 'dados']

4. Remoção de Stopwords

Em qualquer idioma, existem palavras que funcionam apenas como “cola” sintática, aparecendo com enorme frequência, mas carregando pouquíssimo peso semântico para a compreensão do tópico principal da frase. Essas são as stopwords.

Exemplos clássicos em português incluem preposições, artigos e conjunções:

- de, a, o, e, da, para, com…

Em muitas abordagens tradicionais de modelagem, essas palavras são sumariamente removidas para reduzir a dimensionalidade dos dados e focar no que realmente importa.

5. Stemming e Lemmatização

O português é uma língua rica em flexões (conjugações verbais, plurais, gêneros). Para um computador, “correndo”, “correu” e “correrá” podem parecer três variáveis completamente diferentes, quando, na verdade, tratam do mesmo conceito base.

Para resolver isso, usamos técnicas de normalização que reduzem palavras à sua forma raiz:

- Stemming: Corta os sufixos e prefixos de forma mais “bruta”, baseada em regras. (Ex: correndo $\rightarrow$ corr).

- Lemmatização: Uma abordagem mais sofisticada e inteligente que utiliza o vocabulário e a análise morfológica para retornar o lema ou a forma de dicionário da palavra. (Ex: estudando $\rightarrow$ estudar).

6. Vetorização (Feature Extraction)

Aqui ocorre a verdadeira tradução da linguagem humana para a linguagem de máquina. Computadores não entendem strings de texto diretamente; eles processam matrizes e tensores matemáticos.

Por isso, precisamos converter nossos tokens e lemas em representações numéricas. A evolução histórica dessa etapa define muito do poder do NLP moderno:

- Bag of Words (BoW): Conta a frequência com que cada palavra aparece no documento.

- TF-IDF: Avalia não apenas a frequência de uma palavra, mas a sua raridade em todo o conjunto de dados, dando peso às palavras mais exclusivas e descritivas.

- Word Embeddings e Modelos Contextuais: O estado da arte. Técnicas modernas transformam palavras em vetores densos multidimensionais, capturando relações semânticas profundas. É aqui que arquiteturas como o BERT brilham, sendo essenciais para captar o contexto bidirecional de uma frase e melhorar drasticamente a assertividade em sistemas complexos.

Conclusão

Esse pipeline, da coleta bruta até a vetorização matemática, é a fundação de praticamente todos os sistemas de NLP operando hoje.

Mesmo com o avanço avassalador dos grandes modelos de linguagem (LLMs), compreender a mecânica de como o texto é limpo, particionado e traduzido para números continua sendo uma habilidade inegociável para qualquer cientista de dados que deseje criar soluções robustas, performáticas e eficientes.

No próximo post, vamos explorar como os algoritmos finalmente utilizam esses vetores para prever o futuro das palavras e entender as nossas emoções. Não perca!