Introdução

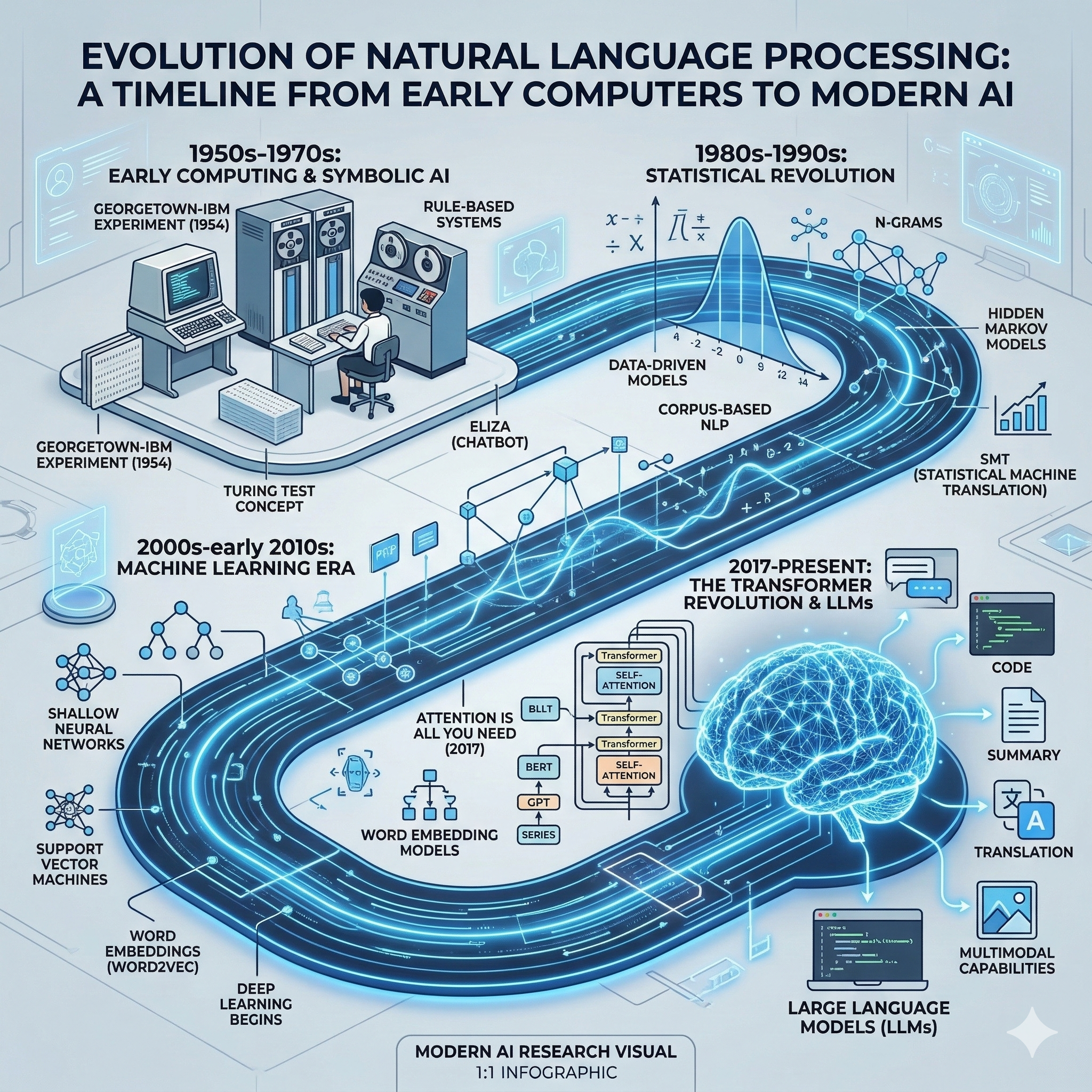

O avanço estrondoso da Inteligência Artificial nos últimos anos, impulsionado por assistentes conversacionais ultrarrealistas, levou muitas pessoas a acreditar que o Processamento de Linguagem Natural (PLN/NLP) é uma invenção recente.

Na realidade, essa área fascinante possui mais de 70 anos de pesquisa científica rigorosa. A jornada para ensinar computadores a falar e entender nosso idioma é uma das histórias mais ricas da ciência da computação, marcada por mudanças de paradigma, invernos da IA e descobertas matemáticas brilhantes.

O Início: O Teste de Turing e a Filosofia da Máquina

Em 1950, muito antes da existência dos computadores pessoais, o brilhante matemático britânico Alan Turing publicou um artigo revolucionário chamado “Computing Machinery and Intelligence”.

Nesse trabalho seminal, Turing propôs o que ficou conhecido como o Teste de Turing (originalmente chamado de Jogo da Imitação). Ele levantou uma questão que ecoa até hoje em nossos laboratórios e fóruns de discussão:

“Uma máquina pode imitar o comportamento humano a ponto de ser indistinguível de uma pessoa em uma conversa?”

Esse conceito não apenas fundou a filosofia por trás da Inteligência Artificial, mas inspirou as primeiras décadas de pesquisa tentando decodificar a linguagem estruturada.

Primeira Geração: Sistemas Baseados em Regras (Anos 1950 – 1980)

Nas primeiras décadas, os pesquisadores acreditavam que a chave para a compreensão da linguagem estava na própria linguística clássica. Os sistemas de NLP dessa época eram estritamente baseados em regras.

Linguistas e cientistas da computação passavam anos criando manualmente:

- Gramáticas formais e complexas;

- Dicionários lexicais extensos;

- Regras sintáticas rígidas para análise de frases (Parsing).

Um exemplo clássico dessa era foi o programa ELIZA (1966), que simulava um psicoterapeuta usando padrões de substituição de palavras. Embora inovadores para a época, esses sistemas esbarraram em uma parede intransponível: a linguagem humana não cabe em caixas lógicas. O modelo não escalava bem para idiomas complexos devido à ambiguidade inerente, ironias, gírias e exceções gramaticais.

A Revolução Estatística (Anos 1990)

Percebendo as limitações das regras manuais, a comunidade científica mudou o foco na década de 1990. Surgiu uma nova abordagem baseada puramente em estatística e probabilidade.

Em vez de ensinar regras de gramática para a máquina, os algoritmos passaram a aprender padrões linguísticos e a probabilidade de certas palavras aparecerem juntas, extraindo isso de grandes conjuntos de dados textuais (Corpora).

Entre os modelos que dominaram essa era, destacam-se:

- Naive Bayes (muito popular para os primeiros filtros de spam);

- Hidden Markov Models (HMMs);

- Modelos de linguagem probabilísticos (como N-grams).

Essa abordagem pragmática trouxe avanços reais e mensuráveis para tarefas complexas, destravando o verdadeiro potencial da tradução automática estatística e do reconhecimento de fala.

A Era do Machine Learning (Anos 2000)

Com a virada do milênio, a internet explodiu. O crescimento exponencial da capacidade computacional e a abundância de dados disponíveis em formato digital criaram o cenário perfeito para que os algoritmos de Aprendizado de Máquina (Machine Learning) passassem a dominar o NLP.

Nesta fase, a extração de características (feature engineering) combinada com algoritmos preditivos permitiu que a máquina começasse a “aprender” de forma mais autônoma. Modelos robustos passaram a ser amplamente utilizados na indústria:

- Support Vector Machines (SVM) para classificação precisa de textos;

- Random Forest;

- Primeiras Redes Neurais Rasas, abrindo caminho para o conceito de Word Embeddings (como o Word2Vec), que transformava palavras em vetores matemáticos, capturando finalmente o significado semântico.

A Revolução dos Transformers (2017)

A história moderna do NLP tem um marco divisor de águas. Em 2017, pesquisadores do Google Research publicaram um artigo que mudaria tudo: “Attention is All You Need”.

Esse trabalho apresentou a arquitetura Transformer. Diferente das redes neurais recorrentes (RNNs) que liam o texto palavra por palavra de forma sequencial, o Transformer introduziu o mecanismo de “Atenção” (Self-Attention). Ele permitiu que o modelo olhasse para todas as palavras de uma frase simultaneamente, entendendo o contexto global e as conexões entre termos distantes.

A partir dessa arquitetura inovadora, nasceram os gigantes que redefiniram o mercado:

- BERT (Bidirectional Encoder Representations from Transformers): Revolucionou a compreensão bidirecional de texto, sendo fundamental para tarefas de alta precisão, desde buscas na web até sistemas avançados de predição de texto e comunicação alternativa.

- Série GPT (Generative Pre-trained Transformer): Com foco na geração de texto fluida e contínua.

A Era Atual: Large Language Models (LLMs)

Hoje, vivemos o ápice dessa evolução com a era dos Large Language Models (LLMs).

Esses modelos não são mais treinados em simples gigabytes de texto, mas sim com volumes imensuráveis de dados da internet e possuem bilhões (e até trilhões) de parâmetros. Eles desenvolveram capacidades emergentes que antes pareciam impossíveis:

- Escrever textos criativos, artigos e laudos técnicos;

- Responder perguntas complexas com raciocínio contextual;

- Gerar e debugar códigos de programação;

- Traduzir idiomas com nuances locais impecáveis.

Conclusão

O Processamento de Linguagem Natural evoluiu incrivelmente: saiu de sistemas rígidos e engessados em regras gramaticais nos anos 1950, passou pela frieza das probabilidades estatísticas, e chegou a modelos de redes neurais profundas capazes de gerar textos complexos e conversar com humanos com naturalidade assustadora.

Essa evolução é a prova viva de como a combinação da tríade sagrada da Ciência de Dados, Dados massivos, Algoritmos inovadores e Capacidade Computacional bruta, pode transformar profundamente a tecnologia e a nossa sociedade.

No próximo artigo desta série, vamos mergulhar na parte técnica e explorar as entranhas dos principais métodos e arquiteturas que fazem essa mágica acontecer. Até lá!